Обновление призвано помочь вебмастерам решить проблему поиска директив, блокирующих конкретные URL-ы внутри больших файлов robots.txt.

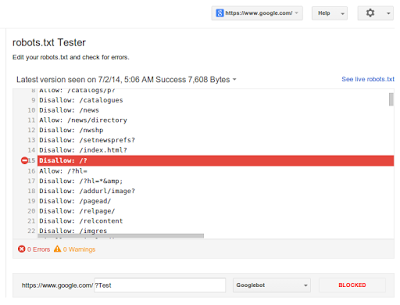

Обновлённая версия robots.txt testing tool:

Специалисты Webmaster Tools рекомендуют проводить двойную проверку файла robots.txt, дополнительно используя другие инструменты сервиса: например, функцию Fetch as Google в разделе «Сканирование» (Crawl), который позволяет вебмастерам просматривать страницы сайтов, содержащие изображения, файлы CSS и JavaScript, как Googlebot.

Представители поиска также предупреждают: в случаях, когда Googlebot обнаруживает внутреннюю ошибку сервера 500, допущенную при добавлении контента в файлы robots.txt file, Google автоматически приостанавливает сканирование веб-сайта.